哎哟,我这暴脾气!记得我第一次跑那个深度学习模型的时候,信心满满地敲下回车,结果等来的不是训练进度条,而是一行冷冰冰的“RuntimeError: CUDA out of memory”-1。当时我就懵了,盯着我那显卡发呆,心里头那个憋屈啊,就像兴冲冲地去吃大餐,结果发现钱包没带一样。

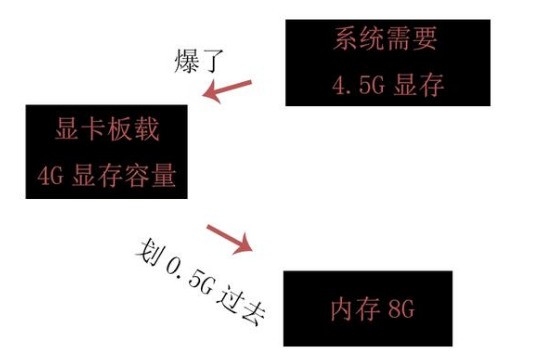

这显存不够会怎么样?说白了,就是你显卡的“工作台”太小,而你要处理的“原材料”(模型参数、数据)太多,根本摆不下-1。最常见的,就是程序直接崩溃,训练中断,弹出一个类似“CUDA内存不足”的错误-3。这不仅仅是打断你的工作那么简单,有时候好几个小时的训练进度说没就没了,那感觉真是“豆腐掉进灰堆里——吹不得也拍不得”。

但这还不是最恼人的。有时候它不直接崩,而是开始“卡顿”,或者出现一些莫名其妙的渲染异常-3。我遇到过更绝的,是因为显存碎片化问题-1。你可以把显存想象成一个仓库,本来有足够的空地放一批大货。但因为你之前频繁地搬进搬出一些小零件,导致空地虽然总面积够,却被分割得七零八碎,没有一块完整的、连续的空间能放下新来的大家伙-3。这时候,系统明明显示还有“空闲”显存,可就是告诉你“内存不足”,那种感觉就像明明家里有地方,却因为东西堆得太乱而找不到地方落脚,简直让人抓狂。

所以,当你开始琢磨“显存不够会怎么样”的时候,其实你已经从单纯抱怨硬件,转向思考如何更聪明地利用资源了。这恰恰是解决问题的第一步。面对这个拦路虎,难道我们只能掏钱换更贵的显卡吗?当然不是!我后来发现,江湖上流传着不少“四两拨千斤”的妙招。

咱们得学会“精简”。一个立竿见影的方法是启用混合精度训练。简单说,就是把模型里大部分计算从FP32(单精度浮点数)转换成FP16(半精度浮点数)。这一下子就能减少将近50%的显存占用,而且对模型精度的影响通常很小-1。PyTorch等框架都有现成的工具(比如torch.cuda.amp)可以帮你自动完成,特别方便-4。

如果模型还是太大,可以试试梯度累积这个技巧。我们训练模型时,一次处理的图片或文本数量叫“批大小”(batch size)。批大小越大,对显存需求就越高。梯度累积的思路是:我们先用一个较小的批大小跑几次,把这几次算出来的梯度都攒起来,等累积到一定程度,再用这些梯度的平均值去更新一次模型参数-1。这样,我们就能用有限的显存,“模拟”出使用更大批大小的效果-4。

对于层数非常深的模型,还有一个“用时间换空间”的终极武器:梯度检查点。它在前向传播时,只保存关键节点的输出,而不是每一层的中间结果。等到反向传播需要时,再临时重新计算那些被丢弃的中间结果-4。这样一来,能省下大量的显存(尤其是存储激活值的那部分),代价就是会增加一些计算时间,大约20%-30%-2-5。这就像你长途旅行,把所有行李都背上会很累(显存不足),但你可以选择只带必需品,中途需要别的再买(重新计算),虽然可能多花点时间,但轻松多了。

除了自己手动优化,我们还可以站在巨人的肩膀上。现在有很多优秀的开源框架,就是专门为了在有限显存下训练大模型而生的。

比如Unsloth这样的框架,它通过动态梯度压缩、注意力机制优化等一系列“黑科技”,能大幅降低训练时的显存占用-2。有测试显示,原本需要32GB以上显存才能训练的百亿参数模型,使用Unsloth优化后,可能只需要7GB左右的显存-2。这简直就是给咱们这些用消费级显卡的研究者和开发者开了扇窗。

另一个思路是模型量化。这是一种模型压缩技术,通过降低模型权重和激活值的数值精度(比如从16位浮点数降到8位甚至4位整数)来减少存储空间-5。一些激进的量化方法,配合参数共享等技术,甚至能尝试将原本需要数十张专业显卡才能运行的、拥有千亿参数的混合专家模型,“塞进”单张24GB的消费级显卡里运行-9。这听上去有点天方夜谭,但确实是目前前沿探索的方向。

当然,如果你有多张显卡(哪怕型号不完全一样),分布式训练是必由之路。通过像ZeRO(零冗余优化器)、张量并行、流水线并行这样的技术,可以把模型参数、梯度、优化器状态巧妙地拆分到不同显卡上-5-6。例如,ZeRO-3阶段能将参数、梯度和优化器状态全部分区,几乎线性地提升可训练的模型规模-5。这就好比一个人干不完的重活,分给一个团队来协作完成。

说到底,遇到显存不足别急着灰心。它更像是一个提醒,逼着我们去更深入地理解模型、框架和硬件之间的协作。从调整batch_size开始,到尝试混合精度、梯度累积,再到研究量化、并行,每一步都在提升我们的“炼丹”功力。这个过程本身,其乐无穷。

1. 网友“新手炼丹师”提问:我刚入门深度学习,显卡只有6GB显存,是不是什么都做不了?有没有特别适合小显存的入门练习项目?

朋友,千万别这么想!6GB显存在几年前可是妥妥的中高端配置,能做很多事情。入门阶段,关键在于选对项目和用好技巧。

避开“巨无霸”模型。不要一上来就去跑最新的千亿参数大语言模型或超高分辨率图像生成模型。可以从一些经典的、轻量级的模型和数据集入手,比如:

图像分类:在CIFAR-10或CIFAR-100数据集上训练ResNet-18、MobileNet这类小模型。把batch_size设小一点(比如32或16),完全可以在6GB显存下流畅运行。

自然语言处理:尝试在GLUE基准的某个任务(如情感分析SST-2)上微调一个BERT-base模型。使用bert-base-uncased这样的版本,配合适当的batch_size和梯度累积,6GB显存是足够的-1。

教程项目:很多优秀的深度学习教程(比如PyTorch官方Tutorials)都会提供适配低显存的代码版本,是完美的起点。

立刻用上“显存节省三件套”:

混合精度训练(AMP):在PyTorch中,几乎可以一键开启。它能立刻让你的可用“显存空间”感觉大了一倍,是低显存用户的第一道护身符-1-4。

梯度累积:这是你“模拟”大batch_size体验的神器。比如你想用batch_size=64的效果,但显存只够一次装16张图,那就设gradient_accumulation_steps=4,跑4次再更新参数,效果类似-1。

及时清理缓存:在PyTorch的训练循环中,可以在每个epoch结束后或内存紧张时调用torch.cuda.empty_cache(),释放掉不用的缓存-1。

养成监控习惯。在训练时,打开终端,用nvidia-smi -l 1命令实时观察显存占用变化-3。这能帮你直观地理解每个操作对显存的影响。入门阶段,在限制下解决问题获得的经验,远比直接用顶级硬件“暴力破解”来得宝贵。坚持住,等你熟练掌握了这些技巧,未来给你大显卡时,你才能把它用得更加出神入化。

2. 网友“创业团队CTO”提问:我们初创公司资金有限,只有几台配置了RTX 4090(24GB显存)的工作站。我们想在本地微调一些百亿参数级别的行业大模型(比如DeepSeek),用于开发产品原型,有可能实现吗?

完全有可能,而且这正是目前很多AI初创公司的标准打法。24GB的消费级旗舰卡,通过组合优化技术,完全有能力应对百亿参数模型的微调(Fine-tuning),尤其是推理(Inference) 任务。关键在于采用“组合拳”策略,而不是硬扛。

核心策略是 “量化+参数高效微调+内存优化” :

模型量化加载:这是第一步,也是降显存占用最猛的一步。不要加载完整的FP16模型。使用bitsandbytes等库,直接以8位(INT8)甚至4位(NF4)精度将模型加载到显存中-5。一个70亿参数的模型,FP16需要约14GB,而INT8只需要约7GB,4位精度则更低。这能让你先把“大象”请进房间。

参数高效微调(PEFT):微调时,不要动模型的所有参数。采用 LoRA(低秩适应) 或其变种QLoRA(量化LoRA) -5。QLoRA的意思是,加载一个4位量化的基础模型,然后只训练额外添加的、参数量极少的LoRA适配器层。这样,需要更新的参数量可能只有原模型的0.1%-1%,显存开销极小,但效果却能接近全量微调。

激活值优化:在微调训练时,开启梯度检查点,以节省存储中间激活值(Activation)的显存-2-5。对于长文本序列任务,可以使用FlashAttention-2等优化的注意力层实现,它能更高效地利用显存-5。

对于产品原型的推理,方案更灵活:

可以加载量化后(如8位)的模型直接进行推理,24GB显存已经可以支持不少百亿模型以不错的批次进行推理。

使用vLLM或TGI这类高性能推理框架,它们自带内存优化、动态批处理等功能,能极大提高显存利用率和吞吐量-9。

如果单卡仍然不够,可以考虑用两台工作站的显卡做简单的模型并行,将模型的不同层分布到不同的卡上。

你们的硬件配置完全在“战斗范围”内。建议的路线是:先从QLoRA微调一个量化模型开始,快速验证想法和效果。随着产品需求的明确和资金的充裕,再考虑租用云上更大显存的实例进行全量微调或部署。这样既能控制成本,又能快速迭代。

3. 网友“业余AIGC爱好者”提问:我喜欢玩Stable Diffusion画图,但我的显卡只有8GB。生成高分辨率(比如1024x1024以上)或者用高精度模型时就经常爆显存。除了换卡,有没有在软件和设置上的优化秘诀?

当然有!AIGC(AI生成内容)社区是“压榨”显卡潜力的高手,针对Stable Diffusion(SD)这类扩散模型,有很多成熟的优化方案。

第一,启用终极省显存模式:xFormers和注意力切片。

安装xFormers库:这是对于SD WebUI(或ComfyUI)用户最重要的一步。xFormers库提供了内存高效的自注意力层实现,能显著减少生成高分辨率图像时的显存占用,并且通常还能加快生成速度。在WebUI的启动命令中加入--xformers参数即可。

开启注意力切片:如果即使用了xFormers,生成超大图时还是OOM(显存不足),可以尝试启用--opt-split-attention参数。它会将注意力计算过程进行拆分,进一步降低峰值显存。

第二,玩转模型精度与显存管理。

使用FP16或BF16精度的模型:确保你下载的模型(如.safetensors文件)是FP16格式的,而不是FP32。FP32模型体积大,运行时显存占用也高。

在WebUI设置中开启“显存优化”选项:比如“--medvram”或“--lowvram”模式。--medvram会让SD在生成时更激进地释放暂时不用的数据,适合6-8GB显卡。--lowvram模式会更极端,将所有可能的数据在GPU和CPU之间交换,速度会慢,但能让你在显存很小的情况下“硬跑”起来。

及时清理:生成多批次图片时,可以尝试在每批次之间点击WebUI上的“清理显存”按钮(或调用对应API),释放累积的缓存。

第三,采用“先小后大”的高分辨率生成策略。

直接生成1024x1024以上的图对显存压力巨大。可以采用高分辨率修复(Hires. fix) 或多步法:

先用一个较低的分辨率(比如512x512)生成你满意的构图和内容。

然后启用“高分辨率修复”,选择一个高倍率的放大算法(如R-ESRGAN 4x+),让SD在较低显存消耗下,将图片放大到目标尺寸,并补充细节。这比直接生成大图要节省得多。

第四,考虑使用优化后的推理框架。

如果你有一定技术能力,可以尝试使用像TensorRT这样的工具,为你的特定SD模型和显卡生成高度优化的推理引擎。经过TensorRT优化后,不仅显存占用会降低,生成速度也会有巨大提升。NVIDIA官方和社区都有相关的教程。

8GB显卡玩SD绝对够用,只是不能“无脑”开最高配置。通过软件优化和合理的生成策略,你完全可以流畅地创作出高质量的作品。多逛逛相关社区,你会发现很多和你一样用“神卡”创作出惊人作品的同好。